En 2026, la privacidad ya no es un derecho que se ejerce, sino un lujo que se intenta reconstruir. La explosión de la IA Generativa y los Modelos de Lenguaje de Gran Escala (LLM) ha transformado el rastro digital de ser una simple huella en la arena a convertirse en el ADN con el que se construyen las mentes sintéticas del futuro.

Ya no se trata de que las empresas "sepan" quiénes somos; se trata de que las máquinas están asimilando nuestra esencia para automatizar la condición humana.

El Extractivismo Cognitivo: Más allá de los Datos Personales

Durante décadas, entendimos la privacidad como la protección de "bolsones" de información: nuestro número de tarjeta, nuestra ubicación GPS o nuestra lista de contactos. La IA ha vuelto obsoleta esta visión.

La Transmutación de lo Cotidiano

Para los modelos actuales, la información más valiosa no es el dato estructurado, sino el dato conductual subyacente.

Sintaxis y Psicología: La forma en que estructuras una queja en un chat de servicio al cliente revela tu nivel de neuroticismo o estabilidad emocional.

Latencia de Respuesta: Los milisegundos que tardas en corregir una palabra antes de enviarla son procesados como indicadores de duda o asertividad.

La Ingesta de la "Sombra Digital": Borradores no enviados, fotos descartadas en la nube y notas de voz privadas están siendo utilizados para el Fine-Tuning (ajuste fino) de modelos que buscan replicar la intuición humana.

El Dilema del "Desaprendizaje" de las Máquinas

Uno de los mayores desafíos legales y éticos de esta década es la naturaleza irreversible del entrenamiento de la IA.

El Problema de la Tortilla: Si tus datos personales fueron utilizados para entrenar un modelo, intentar eliminarlos es como intentar sacar un huevo específico de una tortilla ya cocinada. Los datos ya no existen como archivos; existen como pesos probabilísticos dentro de una red neuronal.

Implicaciones del "Machine Unlearning"

Aunque leyes como el GDPR o la Ley de IA de la UE exigen el derecho al olvido, la arquitectura de los Transformers (la base de la IA actual) no permite una "extracción" limpia. Esto genera un conflicto jurídico:

Privacidad Estadística: Si una IA puede predecir tu comportamiento basándose en los datos de "personas parecidas a ti", ¿ha violado tu privacidad aunque no use tus datos nombre por nombre?

Identidades Sintéticas: El riesgo de que se generen perfiles que actúen y decidan como tú, pero que legalmente no sean "tú".

La Identidad Digital de los Jóvenes: Prisioneros del Pasado Algorítmico

Para la generación que hoy tiene entre 10 y 20 años, la privacidad por defecto es un concepto alienígena. Sin embargo, las consecuencias de su rastro digital son mucho más severas que las de las generaciones anteriores.

La Predestinación Algorítmica

Imagina a un joven de 18 años solicitando su primer empleo o un crédito educativo en 2030. Los sistemas de IA de las empresas no solo revisarán sus redes sociales; analizarán una década de interacciones digitales para calcular su:

Índice de Productividad Probable.

Riesgo de Salud Mental a Largo Plazo.

Lealtad Institucional.

El peligro es la pérdida de la "Tabula Rasa". La juventud es, por definición, una etapa de experimentación y error. Pero en un mundo donde la IA captura cada error para integrarlo en un modelo predictivo, el derecho a cambiar y a evolucionar se ve amenazado por un sistema que "recuerda" quién eras a los 13 años mejor que tú mismo.

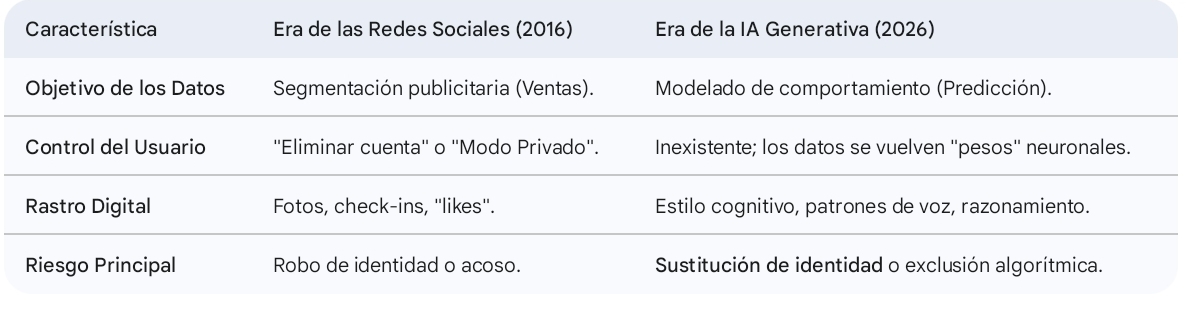

Comparativa: El Cambio de Paradigma (2016 vs 2026)

Hacia una Ética de la "Privacidad de Diseño"

Ante este panorama, la solución no es la desconexión —que en 2026 equivale a la muerte civil— sino una reingeniería ética y técnica.

Estrategias de Resistencia Digital

Ofuscación por IA: El uso de herramientas que inyectan "ruido" en nuestro rastro digital para que los modelos de entrenamiento reciban información contradictoria y no puedan perfilar nuestra esencia real.

Soberanía de Modelos Locales: El movimiento hacia IAs que corren localmente en dispositivos personales (Edge AI), donde los datos de entrenamiento nunca abandonan el hardware del usuario.

Derechos de Propiedad Biométrica y Cognitiva: Nuevas legislaciones que traten nuestra "manera de pensar" y nuestro "estilo de voz" como propiedad intelectual inalienable.

Conclusión: El Despertar de la Conciencia Digital

El fin de la privacidad por defecto es un hecho consumado. Hemos alimentado a la "bestia" con nuestra vida cotidiana y ahora ella nos conoce mejor de lo que nos conocemos nosotros mismos. El reto de la próxima década para los jóvenes no será esconderse —porque ya no hay dónde— sino reclamar el derecho a ser impredecibles.

La verdadera libertad en la era de la IA no será el anonimato, sino la capacidad de actuar fuera de los patrones que las máquinas han diseñado para nosotros.